رأي

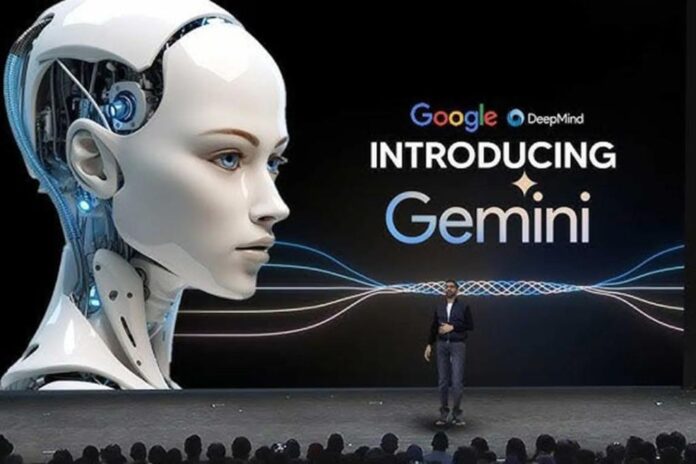

أوقفت Google مؤقتًا طرح أداة البحث عن الصور الخاصة ببرنامج Gemini للذكاء الاصطناعي.

جوجل

الكل يضحك على طرح Google Gemini AI. لكنها ليست مزحة.

المشكلة أخطر من الصور التي تم إنشاؤها غير دقيقة تاريخيا.

إن التلاعب بالذكاء الاصطناعي هو مجرد جانب واحد من “التمييز من خلال الخوارزميات” الأوسع نطاقًا الذي يتم دمجه في الشركات الأمريكية، وقد يكلفك فرص العمل وأكثر من ذلك.

وعندما طُلب من شركة جيميني إنتاج صور لأشخاص بيض، رفضت قائلة إنها لا تستطيع تلبية الطلب لأنه “يعزز الصور النمطية والتعميمات الضارة عن الأشخاص على أساس عرقهم”.

لكنها لم تجد صعوبة في إنتاج صور لأنثى البابا، والفايكنج غير البيض، وجورج واشنطن الأسود.

تواجه أداة التصوير بالذكاء الاصطناعي من Microsoft مشاكلها الخاصة، حيث أنها تنتج صريحة وعنيفة جنسيا الصور.

من الواضح أن التصوير بالذكاء الاصطناعي قد خرج عن القضبان.

وفي حين اعترف الرئيس التنفيذي لشركة جوجل بأن نتائج جيميني كانت “متحيزة” و”غير مقبولة”، فإن هذا ليس خطأً بل ميزة – مثلما أدت نظرية “مناهضة العنصرية” إلى ظهور ممارسات التنوع العنصري والمساواة والشمول بشكل علني.

كواحد منا (وليام) أوضح مؤخرًا لصحيفة The Post: “باسم مكافحة التحيز، يتم بناء التحيز الفعلي في الأنظمة. وهذا مصدر قلق ليس فقط لنتائج البحث، ولكن للتطبيقات الواقعية حيث يؤدي اختبار الخوارزمية “الخالية من التحيز” في الواقع إلى بناء التحيز في النظام من خلال استهداف النتائج النهائية التي تصل إلى حصص.”

مشروعنا للحماية المتساوية (EqualProtect.org) دق ناقوس الخطر منذ عام تقريبًا، عندما كشفنا عن استخدام الخوارزميات للتلاعب بمجموعات المتقدمين للوظائف في وظيفة “التنوع في التوظيف” في LinkedIn.

ينكدين مبررة التلاعب العنصري وغيره من مجموعات الهوية حسب الضرورة “للتأكد من حصول الناس على فرص متساوية” للحصول على فرص العمل، ولكن ما كان يعنيه بـ “المساواة في الوصول” كان في الواقع معاملة تفضيلية.

مثل هذا التحيز يعمل في الظل. لا يرى المرشحون للوظائف كيف تؤثر الخوارزميات على توقعاتهم.

يمكن أن تُستخدم الخوارزميات، وهي تُستخدم حاليًا، لرفع مستوى مجموعات معينة على غيرها.

لكن الأمر لا يقتصر على LinkedIn.

أصدرت إدارة بايدن أمرًا تنفيذيًا يطالب بخوارزميات خالية من التحيز، ولكن بموجب عنوان DEI التقدمي المدمج في هذه السياسة، لا يظهر عدم التحيز في المعاملة المتساوية، بل في “الإنصاف”.

إن الأسهم هي كلمة رمزية للحصص.

في عالم اختبار الخوارزميات “الخالية من التحيز”، يكون التحيز مدمجًا لتحقيق العدالة.

وما حدث مع برج الجوزاء هو مثال على مثل هذه البرمجة.

إن الحصول على نتيجة بحث سيئة أمر واحد؛ إنه شيء آخر تمامًا أن تفقد فرصة عمل.

كما أوضح المحامي ستيوارت بيكر، الخبير في مجال تكديس الأسطح، في حدث EPP“، “منع التحيز. . . في الذكاء الاصطناعي سيكون دائمًا بمثابة رمز لفرض حصص خفية.

وسوف ينمو المدى الخبيث للتحيز “الخالي من التحيز”.

التمييز بواسطة الخوارزمية لديه القدرة على التلاعب بكل التفاصيل الرئيسية في حياتنا من أجل الحصول على نتائج جماعية وحصص جماعية.

تم تصميم هذه الخوارزميات للتخلص من آفة DEI وإدخالها سرًا في كل جانب من جوانب الحياة والاقتصاد.

الناس هم عمدا “تعليم” الذكاء الاصطناعي أن صور الفايكنج السود هي نتيجة أكثر إنصافًا من الحقيقة.

نظرًا لأن شركات التكنولوجيا الكبرى تعرف الكثير عنك بالفعل، بما في ذلك عرقك وانتمائك العرقي، فليس من الصعب تخيل التمييز من خلال الخوارزمية التي تتلاعب بالوصول إلى مجموعة من السلع والخدمات.

هل تم رفض طلبك للحصول على وظيفة، أو قرض، أو شقة، أو قبول جامعي؟ يمكن أن تكون خوارزمية “خالية من التحيز” في العمل.

لكنك لن تتمكن أبدًا من إثبات ذلك، لأن الخوارزميات تعمل بعيدًا عن الأنظار وفي سرية، ومعتمدة على أنها “خالية من التحيز”. لأن إنهم يبنون تحيزًا في النظام لتحقيق الحصص.

يمكنك الحصول على الصورة.

يشكل التمييز بواسطة الخوارزمية تهديدًا للمساواة ويجب إيقافه.

ويليام أ. جاكوبسون هو أستاذ القانون السريري في جامعة كورنيل ومؤسس مشروع الحماية المتساوية، حيث يشغل كيمبرلي كاي منصب مدير العمليات والتحرير.

تحميل المزيد…

{{#isDisplay}}

{{/isDisplay}}{{#isAniviewVideo}}

{{/isAniviewVideo}}{{#isSRVideo}}

{{/isSRVideo}}